☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

今年以来以chatgpt为代表的大模型的惊艳表现彻底点燃了AICG这个领域的。各类gpt,各种AI作图产品如雨后春笋般出现。每个成功产品的背后都是一个个精妙的算法,本篇文章给大家详细介绍下如何使用一个手机拍摄若干张同一场景的照片,然后合成新视角,生成视频的流程与代码。本文使用的技术是NeRF(Neural Radiance Fields),它是2025年以来出现的一种基于深度学习的3D重建方法,它通过学习场景的光线传输和辐射传递,能够生成高质量的场景渲染图像和3D模型。关于它的原理与文献,我在最后有一个参考列表供大家学习。本文主要从代码使用以及环境搭建的新角度介绍它。

本文使用的硬件环境是 GPU RTX3090,操作系统是windows 10.采用的软件是开源的NeRF实现(https://github.com/cjw531/nerf_tf2)。由于RTX 3090需要CUDA 11.0及以上版本的支持,TensorFlow-gpu 需要2.4.0以及以上的支持,所以我们没有选择官方的https://github.com/bmild/nerf,因为bmild这个的环境使用的tensorflow-gpu==1.15,版本太久了。跑起来会有下面的问题https://github.com/bmild/nerf/issues/174#issue-1553410900,我在这个tt中也回复指出了需要升级到2.8。但是即便是使用https://github.com/cjw531/nerf_tf2,它的环境也是有点问题。首先由于它连接的国外的conda的channel,所以速度很慢。其次它的环境使用的是tensorflow==2.8没有指明tensorflow-gpu的版本。针对这两个问题。我们对environment.yml进行了修改。

# To run: conda env create -f environment.ymlname: nerf_tf2channels:- https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/conda-forge/- conda-forgedependencies:- python=3.7- pip- cudatoolkit=11.0- cudnn=8.0- numpy- matplotlib- imageio- imageio-ffmpeg- configargparse- ipywidgets- tqdm- pip:- tensorflow==2.8- tensorflow-gpu==2.8- protobuf==3.19.0- -i https://pypi.tuna.tsinghua.edu.cn/simple

打开cmd,然后输入下面的命令。

conda env create -f environment.yml

将nerf_tf2加入到jupyter中,这样使用jupyter能很方便的查看系统的运行结果。

// 安装ipykernelconda install ipykernel

//是该conda环境在jupyter中显示python -m ipykernel install --user --name 环境名称 --python -m ipykernel install --user --name 环境名称 --display-name "jupyter中显示名称"display-name "jupyter中显示名称"

//切换到项目目录cd 到项目目录//激活conda环境activate nerf_tf2//在cmd启动jupyterjupyter notebook

至此conda环境以及jupyter准备就绪。

手机拍摄的图片样例

feature_extractor_args = ['colmap', 'feature_extractor','--database_path', os.path.join(basedir, 'database.db'),'--image_path', os.path.join(basedir, 'images'),'--ImageReader.single_camera', '1',# '--SiftExtraction.use_gpu', '0',]

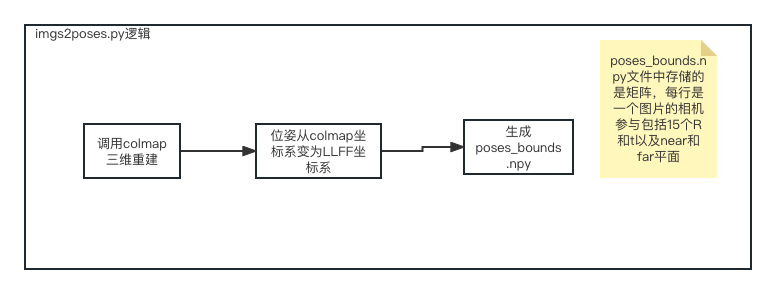

python imgs2poses.py

运行完imgs2poses.py文件后,生成了sparse目录、colmap_out.txt、database.db、poses_bounds.npy,然后我们在nerf_tf2项目下创建新目录data/nerf_llff_data/ll,将上面的sparse目录以及poses_bounds.npy复制到这个目录下。最后我们再配置个新文件config_ll.txt。至此我们的数据准备工作完成了。

expname = ll_testbasedir = ./logsdatadir = ./data/nerf_llff_data/lldataset_type = llfffactor = 8llffhold = 8N_rand = 1024N_samples = 64N_importance = 64use_viewdirs = Trueraw_noise_std = 1e0

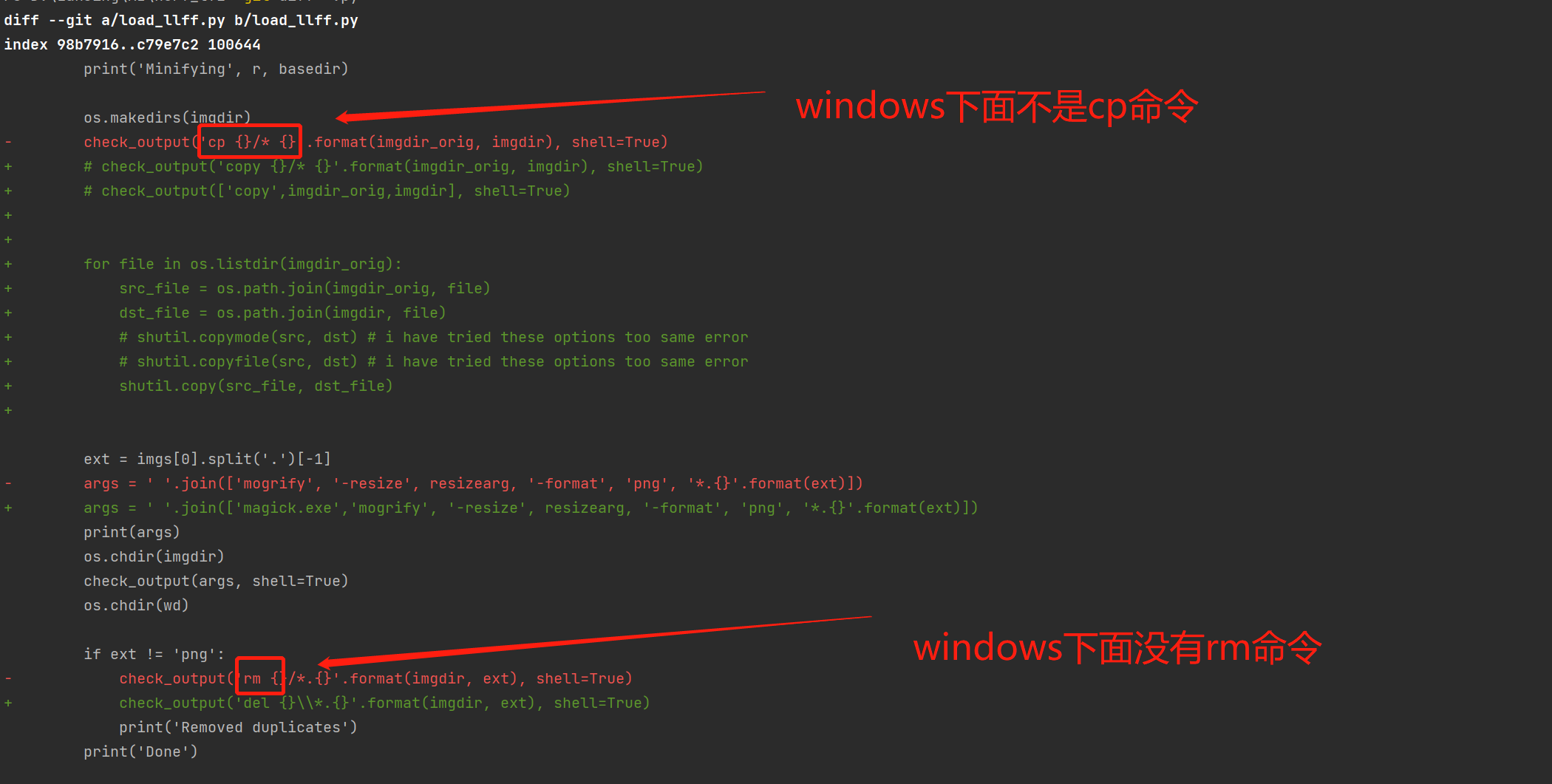

将开源软件迁移到windows平台上。

由于此开源软件主要是支持mac和linux,它无法在windows运行,需要对load_llff.py的修改。

load_llff代码迁移

运行300000次批量训练。

activate nerf_tf2python run_nerf.py --config config_ll.txt

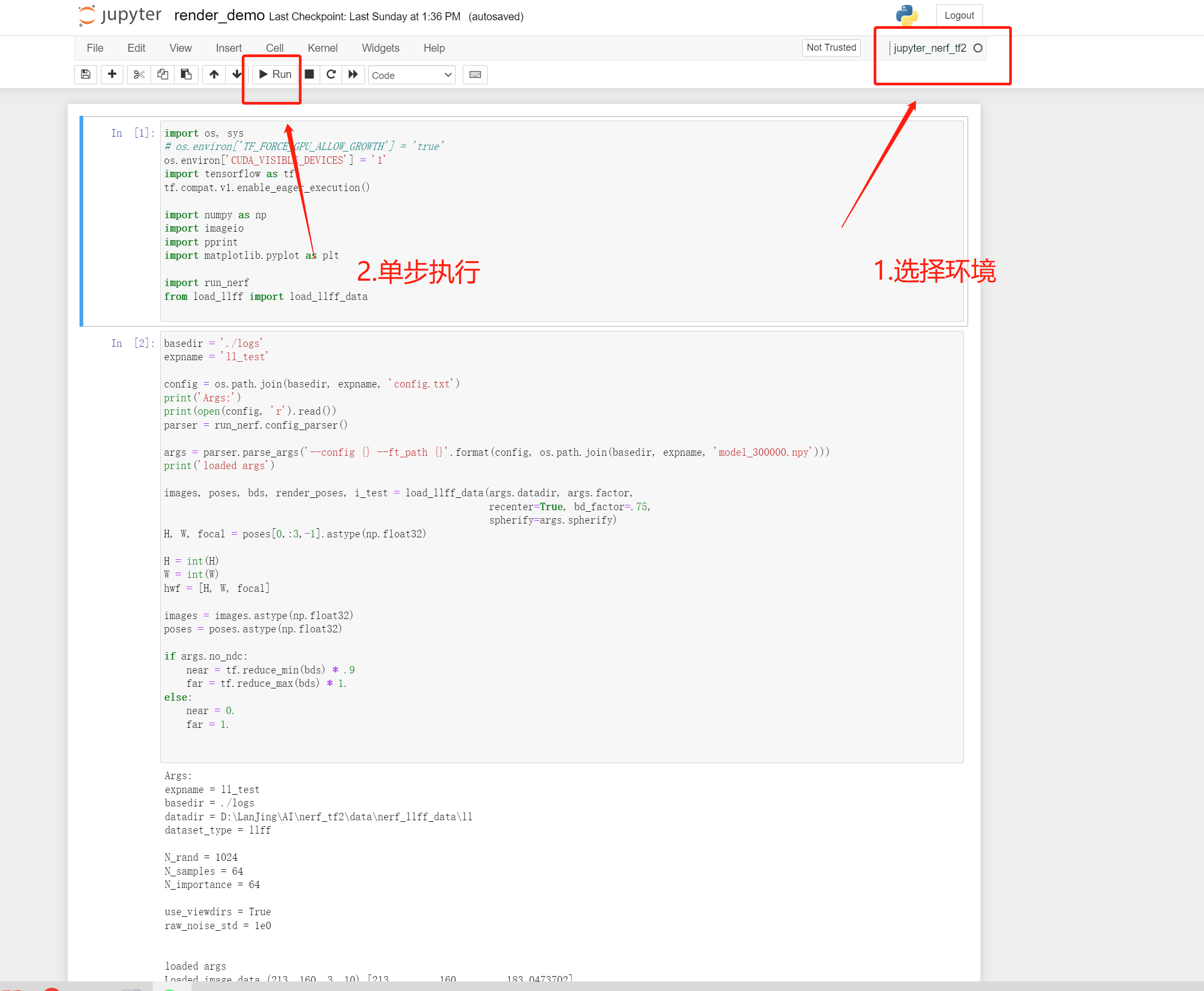

render_demo的运行

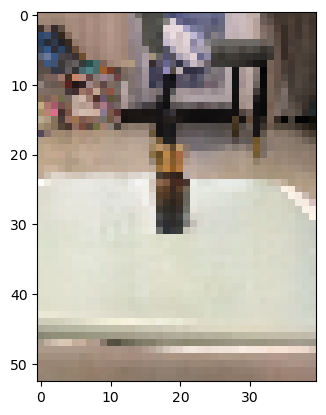

由于我们使用的输入图片有些少,只有10张,所以运行出来的效果不是很好,但是整体的流程是一样。tips:官方的代码里面使用的一半都是30,甚至100张图片。

一个新视角的渲染

fern官方合成新视角效果

https://zhuanlan.zhihu.com/p/554093703。

https://arxiv.org/pdf/2003.08934.pdf。

https://zhuanlan.zhihu.com/p/593204605。

诚客在线考试平台管理系统

诚客在线考试平台管理系统

诚客在线考试是由南宁诚客网络科技有限公司开发的一款手机移动端的答题网站软件,它应用广泛适合各种学校、培训班、教育机构、公司企业、事业单位、各种社会团体、银行证券等用于学生学习刷题、员工内部培训,学员考核、员工对公司制度政策的学习……可使用的题型有:单选题、多选题、判断题支持文字,图片,音频,视频、数学公式。可以设置考试时间,答题时间,考试次数,是否需要补考,是否可以看到自己成绩。练习模式,支持学生

0

查看详情

0

查看详情

https://inst.eecs.berkeley.edu/~cs194-26/fa22/Lectures/nerf_lecture1.pdf。

以上就是自己动手使用AI技术实现数字内容生产的详细内容,更多请关注其它相关文章!

# 中国

# 大连市网站推广公司

# 网站建设企业营销推广

# 阿里营销推广哪一种好

# 网站建设网店名字

# 新疆建设职业学院网站

# 世纪百捷seo案例

# 成都微信网站推广服务

# 做seo优化需要什么

# 黄梅网站建设方案

# 温州专业网站推广

# 的是

# 藏着

# 深度学习

# 微软

# 我在

# 都是

# 门店

# 管理系统

# 自己动手

# 开源

# type

# fig

# chatgpt

# nerf

相关栏目:

【

Google疑问12 】

【

Facebook疑问10 】

【

优化推广96088 】

【

技术知识133117 】

【

IDC资讯59369 】

【

网络运营7196 】

【

IT资讯61894 】

相关推荐:

击败LLaMA?史上超强「猎鹰」排行存疑,符尧7行代码亲测,LeCun转赞

AI框架生态峰会本周开幕 华为昇腾“朋友圈”再聚首 全球首个全模态大模型将登场

英伟达首席执行官黄仁勋:生成式 AI 时代「人类」会是新的编程语言

印象笔记开放旗下“印象 AI”,可一键生成思维导图、写文章等

实践J*a开发,构建高性能的MongoDB数据迁移工具

华为发布两款AI存储新品

智能机器人正在彻底改变客户服务

洞穴探险神器?可自主导航的单旋翼自旋无人机,效率更高!

大疆 DJI Mini 4 Pro 无人机曝光:流线设计,有望迎来功能性提升

如布AI口袋学习机S12 将亮相综艺节目《好样的!国货》

“可用”“有用”的讯飞星火认知大模型将亮相世界人工智能大会

人工智能写作检测工具不靠谱,美国宪法竟被认为是机器人写的

Intel酷睿Ultra发布会官宣!迈向全新的AI时代

人工智能在项目管理中的作用

OpenAI更新GPT-4等模型,新增API函数调用,价格最高降75%

曝索尼在开发新头显设备:游戏中使用AR技术

你们的开机第一屏画面要变了!安卓机器人首次3D化

脑机接口产业联盟发布十大脑机接口关键技术

自动驾驶汽车避障、路径规划和控制技术详解

第四范式「式说」大模型入选《2025年通用人工智能创新应用案例集》

加强高质量数据供应能力,促进通用人工智能大模型领域的创新

如何利用物联网技术提高企业生产线智能化水平,提升生产效率

视觉中国推出AI灵感绘图功能,付费后可在“合法合规前提下使用”

数据科学,解码智能未来——Altair首次提出“Frictionless AI”概念

280万条多模态指令-响应对,八种语言通用,首个涵盖视频内容的指令数据集MIMIC-IT来了

华为余承东表示:鸿蒙可能拥有强大的人工智能大模型能力

华为盘古AI模型实现秒级全球气象预报时间缩短

映宇宙集团执行总编辑:元宇宙还是要以人为媒介

布局智能物联新时代,中国移动“5G+物联网”亮相2025 MWC

《上古卷轴5》AI高清材质包优化游戏中所有怪物

杀入生成式AI的亚马逊云科技,能否再次生成未来?

谷歌将使用公开信息训练 AI 模型,构建更强大的自家产品

美的推出 AI 双视精准避障的自动集尘扫拖机器人 V12,售价仅为2999元

BLIP-2、InstructBLIP稳居前三!十二大模型,十六份榜单,全面测评「多模态大语言模型」

Snap宣布研发出新技术 可大幅提升AI生成图像速度

深企派遣无人机救援队赴京津冀开展防汛救灾任务

航拍无人机怎么选?大疆无人机盘点推荐

国家发改委组织工业机器人产业高质量发展现场会

扎克·施奈德新片《月球叛军》曝剧照 机器人首度现身

普林斯顿Infinigen矩阵开启!AI造物主100%创造大自然,逼真到炸裂

万魔推出AI主攻的运动耳机,开启十年研发新纪元

OpenAI首席执行官表态支持欧盟AI监管

优化系统韧性:故障恢复与监控在RabbitMQ中的应用

掌阅科技入选北京市通用人工智能产业创新伙伴计划第二批成员名单

以分布式网络串联闲置GPU,这家创企称可将AI模型训练成本降低90%

消息称苹果 iPhone 15 系列健康应用将深度融合 AI 技术

旷视入选北京市通用人工智能产业创新伙伴计划

人工智能助力林草行业高质量发展

放弃自动驾驶,也是一种和解

苹果2万5的AR遭遇砍单95%:不及预期

2023-06-15

运城市盐湖区信雨科技有限公司是一家深耕海外推广领域十年的专业服务商,作为谷歌推广与Facebook广告全球合作伙伴,聚焦外贸企业出海痛点,以数字化营销为核心,提供一站式海外营销解决方案。公司凭借十年行业沉淀与平台官方资源加持,打破传统外贸获客壁垒,助力企业高效开拓全球市场,成为中小企业出海的可靠合作伙伴。