通过对齐三维形状、二维图片以及相应的语言描述,多模态预训练方法也带动了3D表征学习的发展。

不过现有的多模态预训练框架收集数据的方法缺乏可扩展性,极大限制了多模态学习的潜力,其中最主要的瓶颈在于语言模态的可扩展性和全面性。

最近,Salesforce AI联手斯坦福大学和得克萨斯大学奥斯汀分校,发布了ULIP(CVP R2025)和ULIP-2项目,这些项目正在引领3D理解的新篇章。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

论文链接:https://arxiv.org/pdf/2212.05171.pdf

论文链接:https://arxiv.org/pdf/2305.08275.pdf

代码链接:https://github.com/salesforce/ULIP

研究人员采用了独特的方法,使用3D点云、图像和文本进行模型的预训练,将它们对齐到一个统一的特征空间。这种方法在3D分类任务中取得了最先进的结果,并为跨领域任务(如图像到3D检索)开辟了新的可能性。

并且ULIP-2将这种多模态预训练变得可以不需要任何人工标注,从而可以大规模扩展。

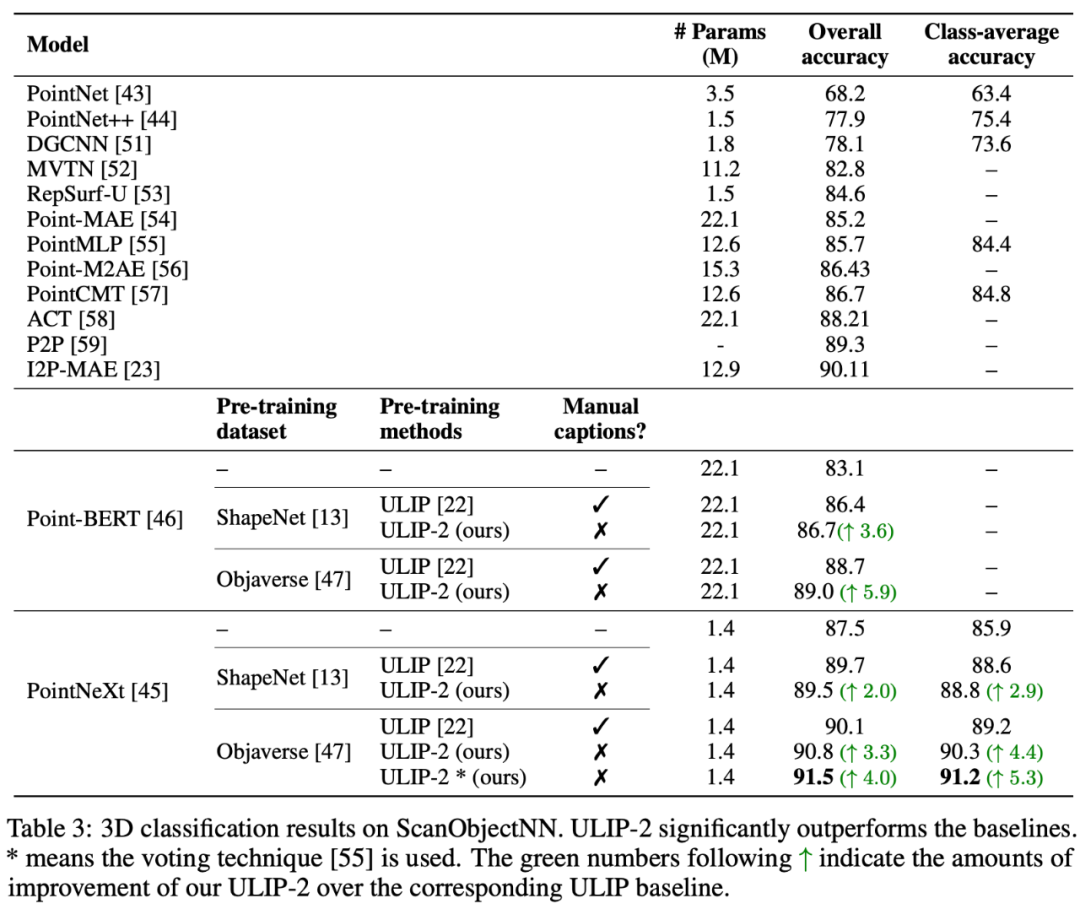

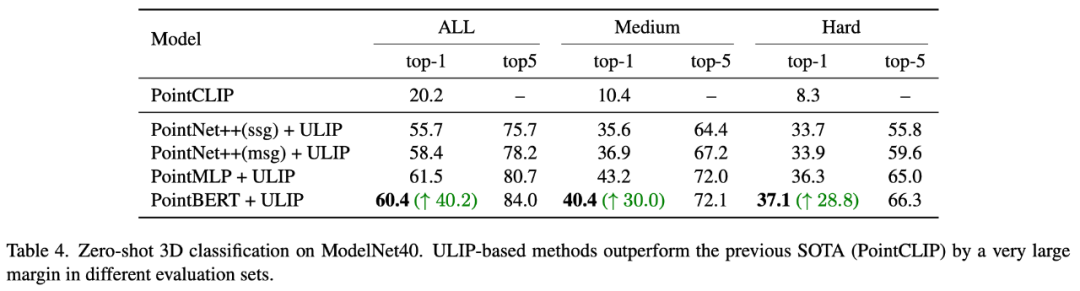

ULIP-2在ModelNet40的下游零样本分类上取得了显著的性能提升,达到74.0%的最高准确率;在现实世界的ScanObjectNN基准上,仅用140万个参数就获得了91.5%的总体准确率,标志着在无需人类3D标注的可扩展多模态3D表示学习方面的突破。

对齐(3D,图像,文本)这三种特征的预训练框架示意图

代码以及发布的大规模tri-modal的数据集(「ULIP - Obj*erse Triplets」和「ULIP - ShapeNet Triplets」)已经开源。

3D理解是人工智能领域的重要组成部分,它让机器能像人类一样在三维空间中感知和互动。这种能力在自动驾驶汽车、机器人、虚拟现实和增强现实等领域都有着重要的应用。

然而,由于3D数据的处理和解释复杂性,以及收集和注释3D数据的成本,3D理解一直面临着巨大的挑战。

Tri-modal 预训练框架以及其下游任务

ULIP(已经被CVPR2025接收)采用了一种独特的方法,使用3D点云、图像和文本进行模型的预训练,将它们对齐到一个统一的表示空间。

这种方法在3D分类任务中取得了最先进的结果,并为跨领域任务(如图像到3D检索)开辟了新的可能性。

ULIP的成功关键在于使用预先对齐的图像和文本编码器,如CLIP,它在大量的图像-文本对上进行预训练。

这些编码器将三种模态的特征对齐到一个统一的表示空间,使模型能够更有效地理解和分类3D对象。

这种改进的3D表示学 习不仅增强了模型对3D数据的理解,而且还使得跨模态应用如zero-shot 3D分类和图像到3D检索成为可能,因为3D编码器获得了多模态上下文。

习不仅增强了模型对3D数据的理解,而且还使得跨模态应用如zero-shot 3D分类和图像到3D检索成为可能,因为3D编码器获得了多模态上下文。

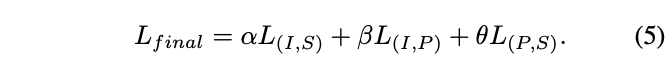

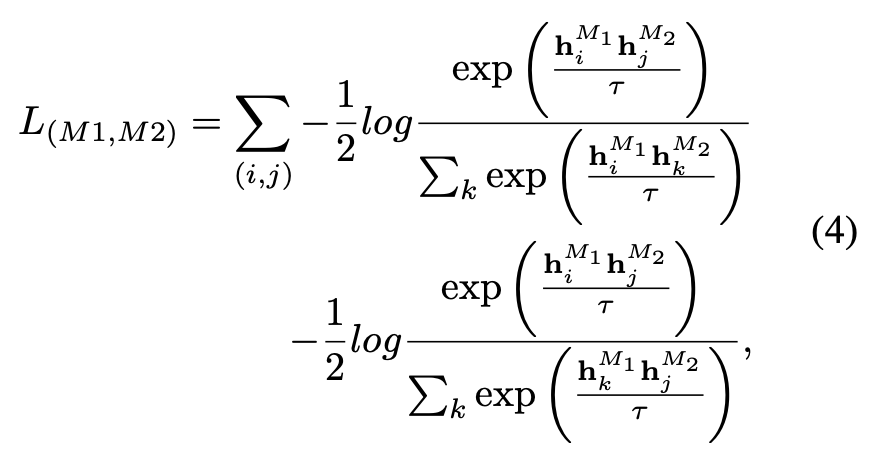

ULIP的预训练损失函数如下:

在ULIP的默认设置中,α被设置为0, β和θ被设置为1,每两个模态之间的对比学习损失函数的定义如下,这里M1和M2指三个模态中的任意两个模态:

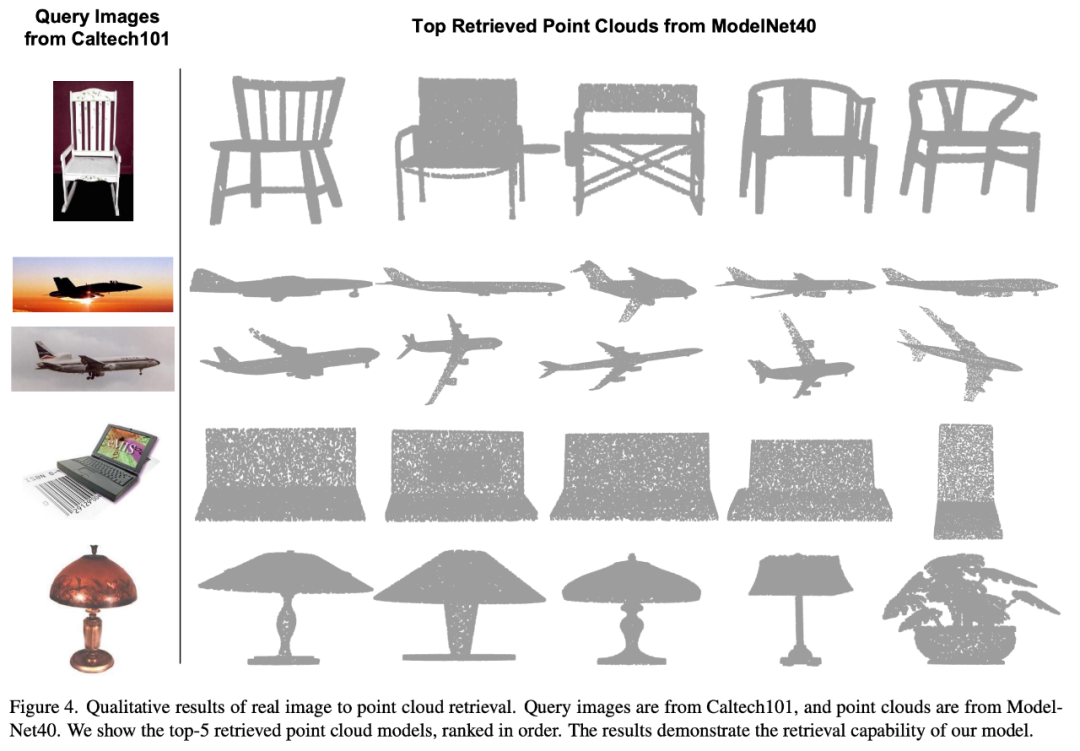

ULIP还做了由图像到3D的retrieval的实验,效果如下:

ChatGPT Writer

ChatGPT Writer

免费 Chrome 扩展程序,使用 ChatGPT AI 生成电子邮件和消息。

106

查看详情

106

查看详情

实验结果可以看出ULIP预训练的模型已经能够学习到图像和三维点云间有意义的多模态特征。

令人惊讶的是,相较于其他的检索到的三维模型,第一名检索到的三维模型与查询图像的外观最为接近。

例如,当我们使用来自不同飞机类型(战斗机和客机)的图片进行检索(第二行和第三行),检索到的最接近的3D点云仍然保留了查询图像的微妙差异。

这里是一个3D物体生成多角度文字描述的示例。我们先将3D物体以一组视角渲染成2D图像,接着使用大型多模态模型为所生成的所有图像生成描述

ULIP-2在ULIP的基础上,利用大型多模态模型为3D物体生*方面对应的语言描述,从而收集可扩展的多模态预训练数据,无需任何人工标注,使预训练过程和训练后的模型更加高效并且增强其适应性。

ULIP-2的方法包括为每个3D物体生成多角度不同的语言描述,然后用这些描述来训练模型,使3D物体、2D图像、和语言描述在特征空间对齐一致。

这个框架使得无需手动注释就可以创建大量的三模态数据集,从而充分发挥多模态预训练的潜力。

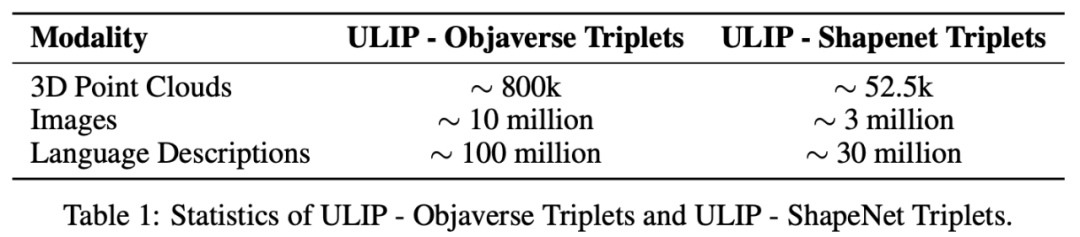

ULIP-2还发布了生成的大规模三模态数据集:「ULIP - Obj*erse Triplets」和「ULIP - ShapeNet Triplets」。

两个tri-modal的datasets的一些统计数据

ULIP系列在多模态下游任务和3D表达的微调实验中均取得了惊人的效果,尤其ULIP-2中的预训练是完全不需要借助任何人工的标注就可以实现的。

ULIP-2在ModelNet40的下游零样本分类任务中取得了显著的提升(74.0%的top-1准确率);在真实世界的ScanObjectNN基准测试中,它仅用1.4M参数就取得了91.5%的总体准确率,这标志着在无需人工3D标注的情况下,实现了可扩展的多模态3D表示学习的突破。

两篇论文均做了详尽的消融实验。

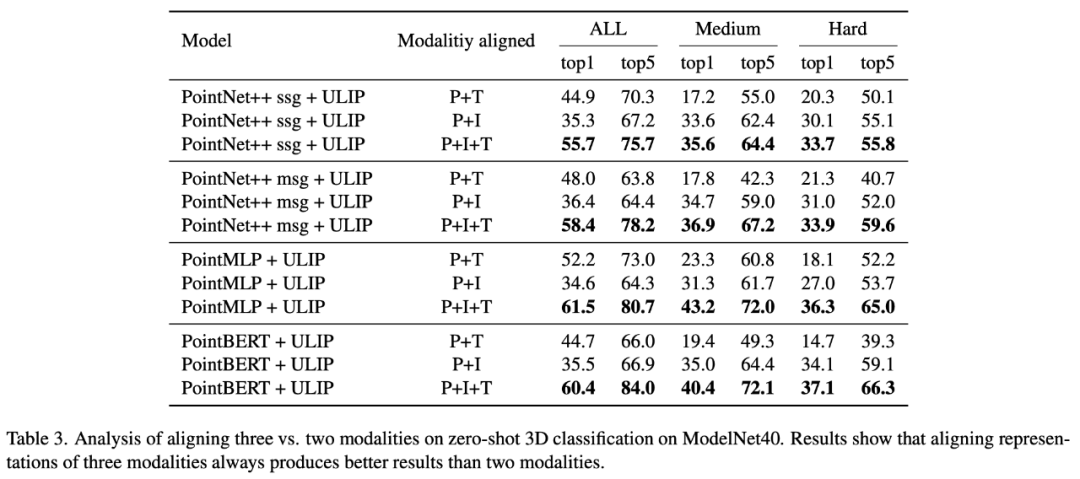

在「ULIP: Learning a Unified Representation of Language, Images, and Point Clouds for 3D Understanding」中,由于ULIP的预训练框架有三个模态的参与,所以作者用实验探究了究竟是只对齐其中的两个模态好还是对齐所有三个模态好,实验结果如下:

从实验结果中可以看到,在不同的3D backbone中,对齐三个模态一致的比只对齐两个模态好,这也应证了ULIP的预训练框架的合理性。

在「ULIP-2: Towards Scalable Multimodal Pre-training for 3D Understanding」中,作者探究了不同的大型多模态模型会对预训练的框架有什么影响,结果如下:

实验结果可以看出,ULIP-2框架预训练的效果可以随着使用的大型多模态模型的升级而提升,具有一定的成长性。

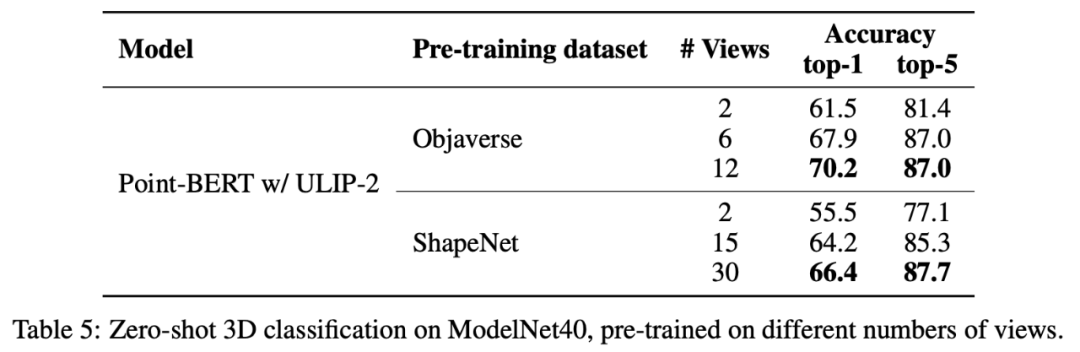

在ULIP-2中,作者还探索了在生成tri-modal的数据集是采用不同数量的视角会如何影响整体预训练的表现,实验结果如下:

实验结果显示,随着使用的视角数量的增加,预训练的模型的zero-shot classification的效果也会随之增加。

这也应证了ULIP-2中的观点,更全方位多样性的语言描述会对多模态预训练有正向的作用。

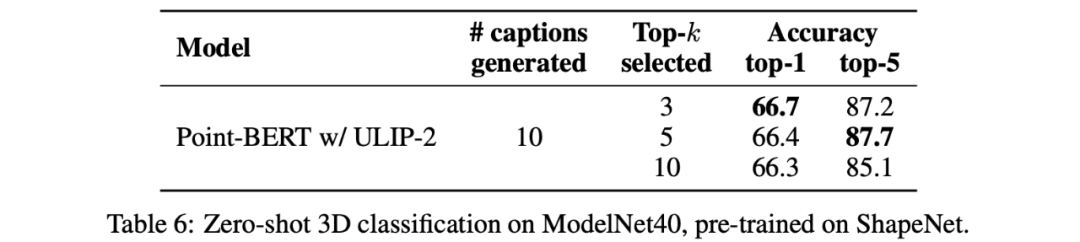

除此之外,ULIP-2还探究了取CLIP排序过的不同topk的语言描述会对多模态预训练有什么影响,实验结果如下:

实验结果表明:ULIP-2的框架对不同的topk有一定的鲁棒性,论文中采用了top 5作为默认设置。

由Salesforce AI,斯坦福大学,得克萨斯大学奥斯汀分校联手发布的ULIP项目(CVPR2025)和ULIP-2正在改变3D理解领域。

ULIP将不同的模态对齐到一个统一的空间,增强了3D特征的学习并启用了跨模态应用。

ULIP-2进一步发展,为3D对象生成整体语言描述,创建并开源了大量的三模态数据集,并且这个过程无需人工标注。

这些项目在3D理解方面设定了新的基准,为机器真正理解我们三维世界的未来铺平了道路。

Salesforce AI:

Le Xue (薛乐), Mingfei Gao (高明菲),Chen Xing(星辰),Ning Yu(于宁), Shu Zhang(张澍),Junnan Li(李俊男), Caiming Xiong(熊蔡明),Ran Xu(徐然),Juan carlos niebles, Silvio s*arese。

斯坦福大学:

Prof. Silvio S*arese, Prof. Juan Carlos Niebles, Prof. Jiajun Wu(吴佳俊)。

UT Austin:

Prof. Roberto Martín-Martín。

以上就是无需标注数据,「3D理解」进入多模态预训练时代!ULIP系列全面开源,刷新SOTA的详细内容,更多请关注其它相关文章!

# 有什么

# 句容seo快排

# 营销推广方式就择火1星

# 做推广的网站的公司

# 精准获客营销推广

# 线上农产品网站推广方案

# 黑帽seo学习论坛

# 一个营销号推广赚钱吗

# 网站优化软件推荐电脑

# 昌黎环保网站建设配置

# 兰州网站推广团队有哪些

# 3D

# 前十

# 会对

# 采用了

# 斯坦福大学

# 得克萨斯

# 奥斯汀

# 模态

# 开源

# 多模

# 机器

相关栏目:

【

Google疑问12 】

【

Facebook疑问10 】

【

优化推广96088 】

【

技术知识133117 】

【

IDC资讯59369 】

【

网络运营7196 】

【

IT资讯61894 】

相关推荐:

2025世界人工智能大会(上海)开幕式纪要

苹果AR头显商标与华为撞车,在中国或改名

人工智能框架生态峰会即将召开,聚焦AI大模型技术与科学智能探索!

一文读懂自动驾驶的激光雷达与视觉融合感知

小岛秀夫不反对使用AI 但认为人类应该凌驾于AI

华为联合合作伙伴 共同发布昇腾AI大模型训推一体化解决方案

AI证件照生成器:实际测试中AI软件展现了绝无仅有的强大效能

微软向美国政府提供GPT大模型,如何保证安全性?

微软新出热乎论文:Transformer扩展到10亿token

Win11 AI 助手 Windows Copilot 被吐槽:套皮的 Edge 浏览器

2025智源大会AI安全话题备受关注,《人机对齐》新书首发

张朝阳与陆川谈AI:ChatGPT是鹦鹉学舌思维,不可能取代人类 | 把脉AI大模型

AI 冥想应用 Ogimi.ai 推出,可为用户提供教练级个性化指导

2025世界人工智能大会前沿科技共绘“未来”图景, 这家这家独角兽企业的通用大脑将在AI领域大放异彩

谷歌推出新 AI 工具 Imagen Editor,一句话对图片二次创作

深企派遣无人机救援队赴京津冀开展防汛救灾任务

机智云AI离线语音识别模组,让家电变得更加智能便捷

亚马逊确认今年不举办re:MARS人工智能大会

AI赋能艺术 超现实达利奇幻之旅在沪开启

首个算网生态体!中国移动元宇宙产业联盟正式成立

类GPT模型训练提速26.5%,清华朱军等人用INT4算法加速神经网络训练

探索人工智能和物联网的动态融合

GPT-4使用混合大模型?研究证明MoE+指令调优确实让大模型性能超群

英伟达推出 L40S GPU,AI 推理性能超过 A100 约 1.2 倍

如何用AI开创智慧能源新时代?固德威正让能源“通人性”!

李开复:未来几年,人工智能会革了所有人的命,除非你这么做

网易数帆以AI融合创新引领数据分析与软件开发新趋势

人手一部「*」!视频版Midjourney免费可用,一句话秒生酷炫大片惊呆网友

甲骨文与Cohere合作为企业提供生成式人工智能服务

视觉中国宣布推出AI灵感绘图、画面扩展功能

元宇宙技术带你穿梭“大运河”,江苏书展上的数字阅读馆吸睛小读者

五项人工智能尚未能够实现的任务

谷歌新安卓机器人logo曝光:头更大了

GPT-4 模型架构泄露:包含 1.8 万亿参数、采用混合专家模型

扎克伯格吐槽苹果Vision Pro:社交落后Meta太多,无法建设元宇宙

奥比中光子公司和斯坦德机器人深度合作,共同推进新一代激光雷达的研发

新华社联合北大发布AI大模型评测:安全可靠成重点,360智脑表现优异

业内领先 四川大学华西第四医院甲状腺乳腺外科成功进入手术机器人时代

国内阅读行业首款对话式AI应用“阅爱聊”封闭内测

直击上影节 | 光线传媒董事长王长田谈新技术:未来VR放映效果可能媲美影院

消息称字节机器人团队已有约50人,计划年底扩充到上百人

谷歌AudioPaLM实现「文本+音频」双模态解决,说听两用大模型

人工智能创作的“婴儿版超级英雄”,你觉得哪个最可爱

AMD称下半年AI显卡供应充足,不需要像NVIDIA那样加价抢购

五款 AI 网站构建器,任何人都能快速构建网站

第二届光合组织AI解决方案大赛赛果揭晓

人工智能快速发展 打开就业新空间

印象笔记开放旗下“印象 AI”,可一键生成思维导图、写文章等

人工智能驱动艺术,打开达利的超现实想象

软通动力天枢元宇宙研究院签约落户江宁高新区

2023-06-20

运城市盐湖区信雨科技有限公司是一家深耕海外推广领域十年的专业服务商,作为谷歌推广与Facebook广告全球合作伙伴,聚焦外贸企业出海痛点,以数字化营销为核心,提供一站式海外营销解决方案。公司凭借十年行业沉淀与平台官方资源加持,打破传统外贸获客壁垒,助力企业高效开拓全球市场,成为中小企业出海的可靠合作伙伴。