2025年,AI大模型领域的统治者Transformer的地位开始受到挑战。一种新的架构名为「Mamba」崭露头角,它是一种选择性状态空间模型,在语言建模方面与Transformer不相上下,甚至有可能超越它。与此同时,Mamba能够根据上下文长度的增加实现线性扩展,这使得它在处理实际数据时能够处理百万词汇长度的序列,并提升了5倍的推理吞吐量。这一突破性的性能提升令人瞩目,为AI领域的发展带来了新的可能性。

发布后的一个多月里,Mamba开始逐渐展现其影响力,并衍生出了MoE-Mamba、Vision Mamba、VMamba、U-Mamba、MambaByte等多个项目。在不断克服Transformer的短板方面,Mamba显示出了极大的潜力。这些发展显示出Mamba在不断发展和进步,为人工智能领域带来了新的可能性。

然而,这颗冉冉升起的"新星"在2025年的ICLR会议上遇到了挫折。最新的公开结果显示,Mamba的论文目前仍然处于待定状态,我们只能在待定决定一栏中看到它的名字,无法确定是被延迟决定还是被拒绝。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

总体来看,Mamba收到了四位审稿人的评分,分别为8/8/6/3。有人表示,如果遭到这样的评分仍然被拒绝,确实令人感到不解。

要弄清其中的缘由,我们还得看一下打出低分的审稿人是怎么说的。

论文审稿页面:https://openreview.net/forum?id=al1fq05o7h

Machine Translation

Machine Translation

聚合多个来源的AI翻译

49

查看详情

49

查看详情

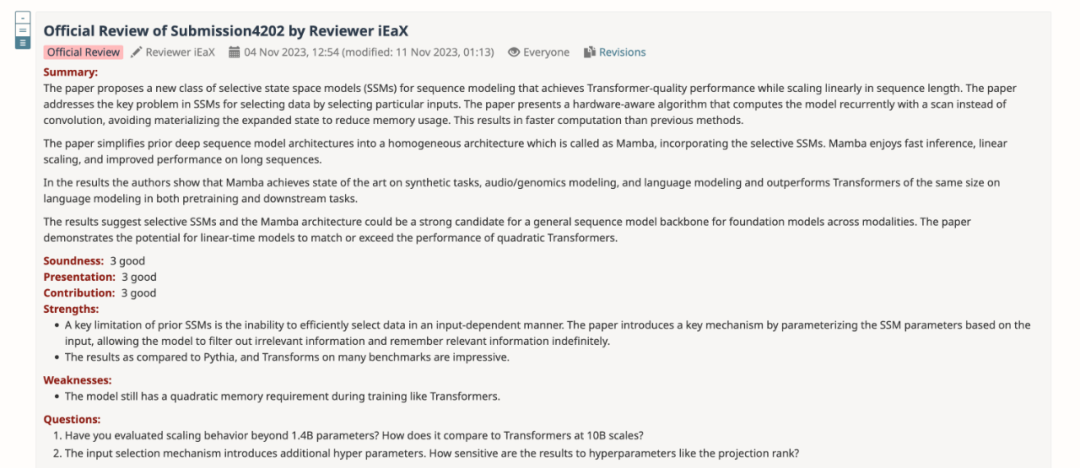

在评审反馈中,给出「3: reject, not good enough」打分的审稿人解释了自己对于 Mamba 的几点意见:

对模型设计的想法:

对实验的想法:

要展示与 H3 的比较。

要展示与 H3 的比较。此外,另一位审稿人也指出 Mamba 存在的不足:该模型在训练过程中仍然像 Transformers 一样具有二次内存需求。

汇总所有审稿人的意见之后,作者团队也对论文内容进行了修改和完善,补充了新的实验结果和分析:

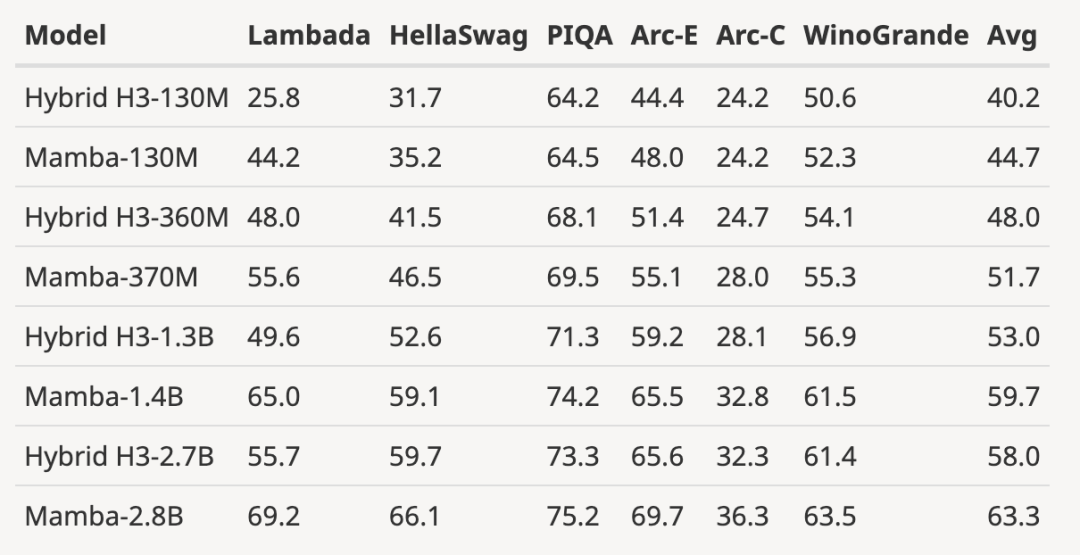

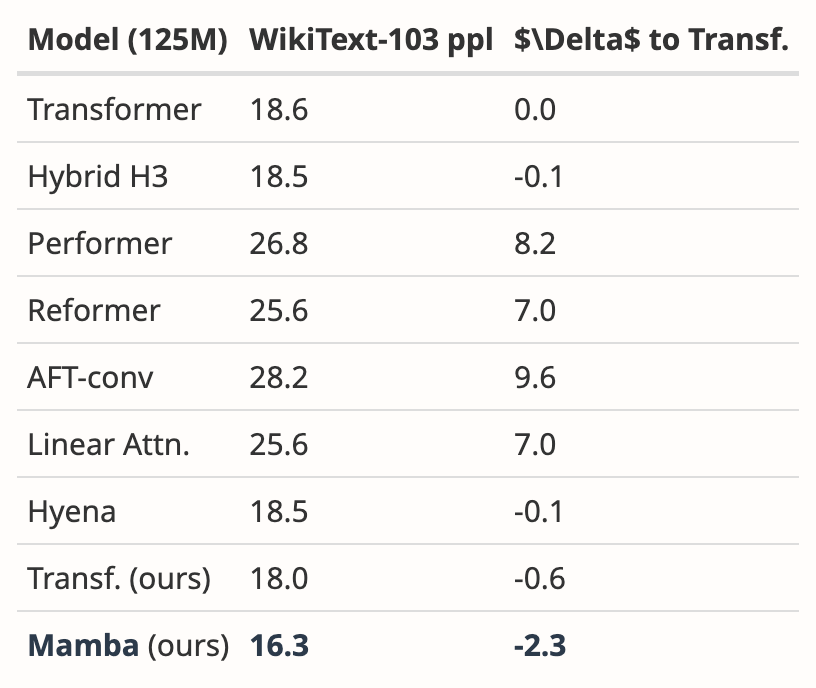

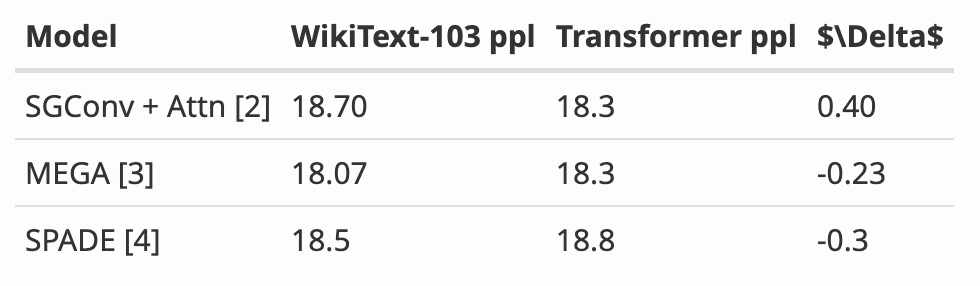

作者下载了大小为 125M-2.7B 参数的预训练 H3 模型,并进行了一系列评估。Mamba 在所有语言评估中都明显更胜一筹,值得注意的是,这些 H3 模型是使用二次注意力的混合模型,而作者仅使用线性时间 Mamba 层的纯模型在各项指标上都明显更优。

与预训练 H3 模型的评估对比如下:

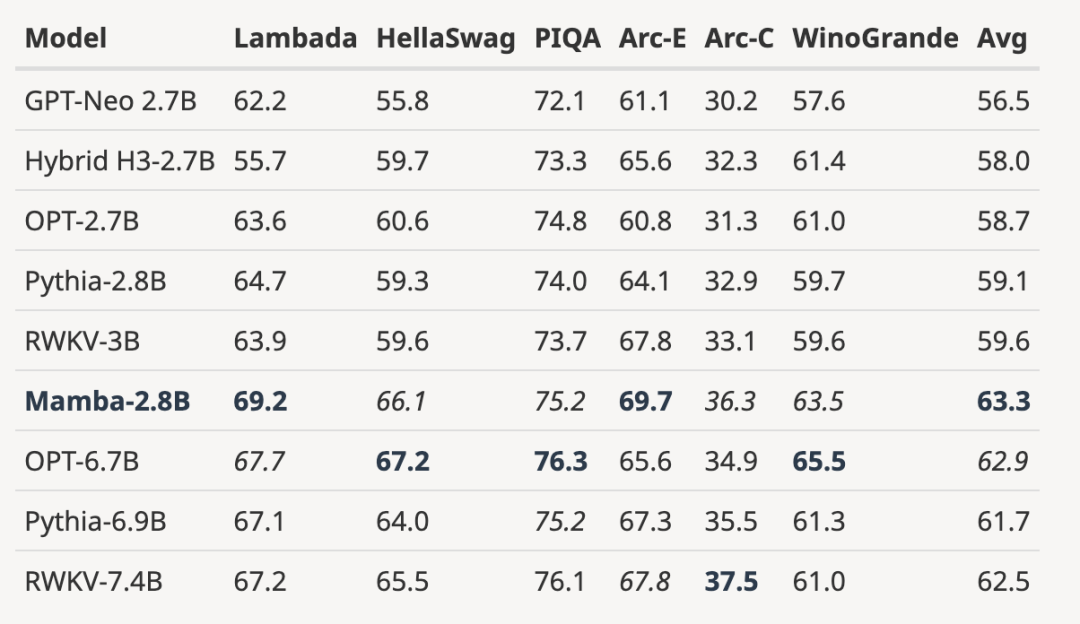

如下图所示,与根据相同 token 数(300B)训练的 3B 开源模型相比,Mamba 在每个评估结果上都更胜一筹。它甚至可以与 7B 规模的模型相媲美:当将 Mamba(2.8B)与 OPT、Pythia 和 RWKV(7B)进行比较时,Mamba 在每个基准上都获得了最佳平均分和最佳 / 次佳得分。

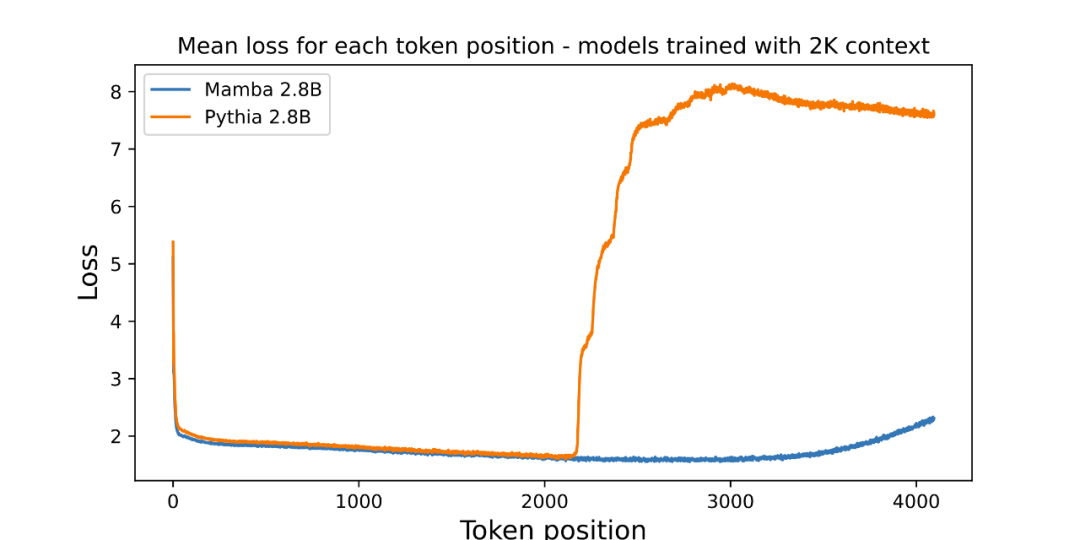

作者附上了一张评估预训练 3B 参数语言模型长度外推的附图:

图中绘出了每个位置的平均损失(对数可读性)。第一个 token 的困惑度很高,因为它没有上下文,而 Mamba 和基线 Transformer(Pythia)的困惑度在训练上下文长度(2048)之前都有所提高。有趣的是,Mamba 的可解性在超过其训练上下文后有了显著提高,最高可达 3000 左右的长度。

作者强调,长度外推并不是本文模型的直接动机,而是将其视为额外功能:

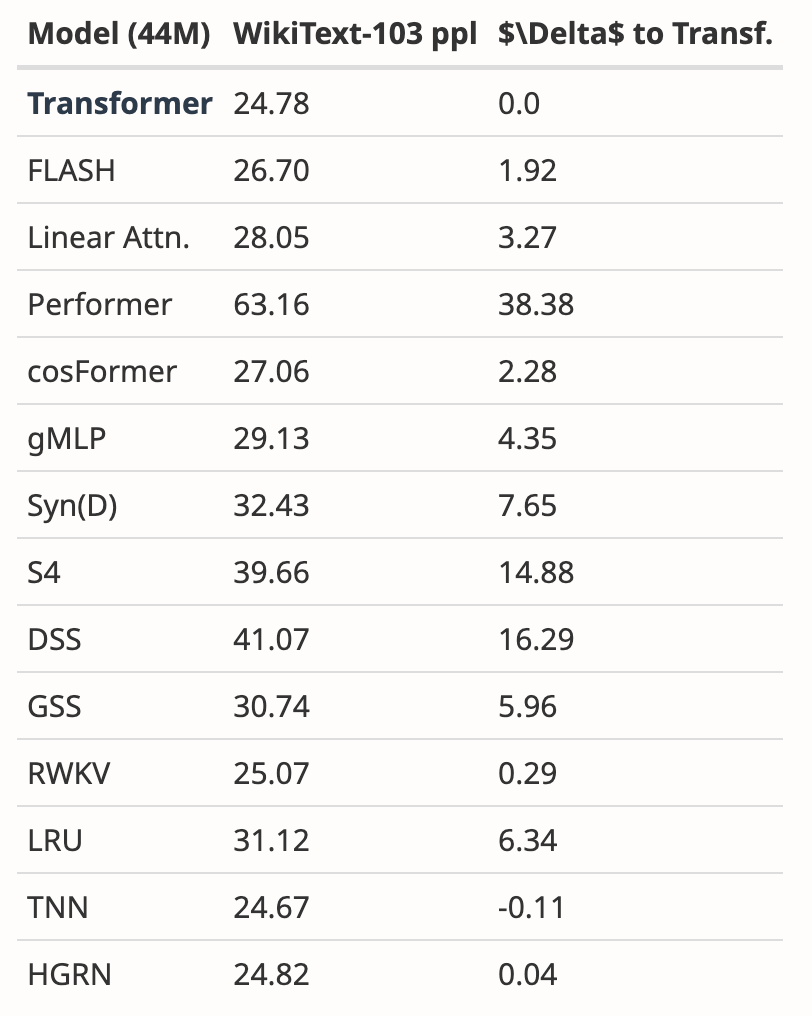

作者分析了多篇论文的结果,表明 Mamba 在 WikiText-103 上的表现明显优于其他 20 多个最新的次二次序列模型。

尽管如此,两个月过去了,这篇论文还处于「Decision Pending」流程中,没有得到「接收」或者「拒绝」的明确结果。

在各大 AI 顶会中,「投稿数量爆炸」都是一个令人头疼的问题,所以精力有限的审稿人难免有看走眼的时候。这就导致历史上出现了很多著名论文被顶会拒绝的情况,包括 YOLO、transformer XL、Dropout、支持向量机(SVM)、知识蒸馏、SIFT,还有 Google 搜索引擎的网页排名算法 PageRank(参见:《大名鼎鼎的 YOLO、PageRank 影响力爆棚的研究,曾被 CS 顶会拒稿》)。

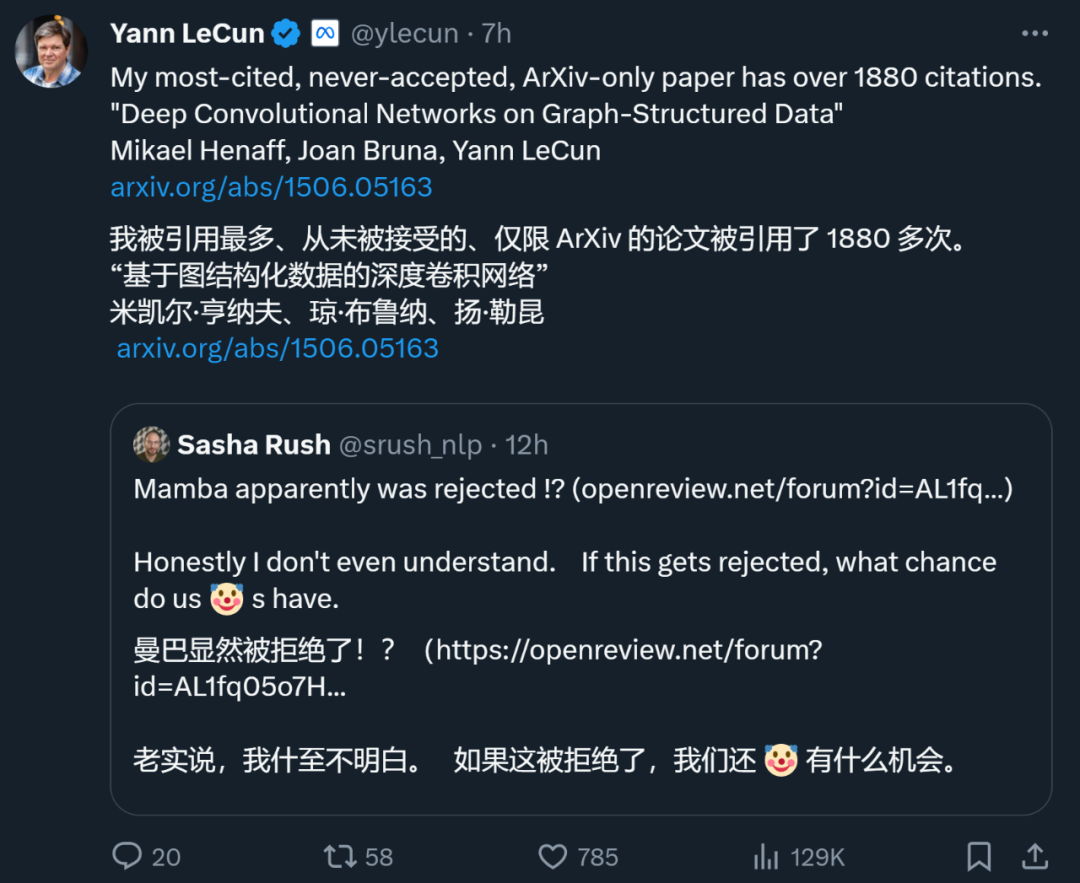

甚至,身为深度学习三巨头之一的 Yann LeCun 也是经常被拒的论文大户。刚刚,他发推文说,自己被引 1887 次的论文「Deep Convolutional Networks on Graph-Structured Data」也被顶会拒绝了。

在 ICML 2025 期间,他甚至「投了三篇,被拒三篇」。

所以,论文被某个顶会拒绝并不代表没有价值。在上述被拒的论文中,很多论文选择了转投其他会议,并最终被接收。因此,网友建议 Mamba 转投陈丹琦等青年学者组建的 COLM。COLM 是一个专注于语言建模研究的学术场所,专注于理解、改进和评论语言模型技术的发展,或许对于 Mamba 这类论文来说是更好的选择。

不过,无论 Mamba 最终能否被 ICLR 接收,它都已经成为一份颇具影响力的工作,也让社区看到了冲破 Transformer 桎梏的希望,为超越传统 Transformer 模型的探索注入了新的活力。

以上就是ICLR为什么没有接受Mamba论文?AI社区掀起了大讨论的详细内容,更多请关注其它相关文章!

# kite

# ai

# seo推广公司询问28火星

# 网站推广专员的优化

# 日照网站建设服务商

# 山南地定制网站建设

# 优化网站都做什么

# 网站优化中心在线咨询

# 速冻糕点营销推广

# 封开网站建设营销推广

# 湖北网站推广公司产品

# 南山网站品牌推广公司

# 有很多

# 出了

# 上都

# 的是

# 多个

# 被拒

# 都是

# 递归

# 度外

# 开源

相关栏目:

【

Google疑问12 】

【

Facebook疑问10 】

【

优化推广96088 】

【

技术知识133117 】

【

IDC资讯59369 】

【

网络运营7196 】

【

IT资讯61894 】

相关推荐:

英伟达CEO宣称生成式AI已迎来“划时代时刻”

人工智能框架生态峰会即将召开,聚焦AI大模型技术与科学智能探索!

随时随地,追踪每个像素,连遮挡都不怕的「追踪一切」视频算法来了

软通动力多项AI创新产品及应用亮相2025世界人工智能大会

OpenAI 为开发者推出 GPT 聊天机器人 API 大更新,同时降低价格

亚马逊确认今年不举办re:MARS人工智能大会

“图壤·阅读元宇宙”亮相北京国际图书博览会

微幼科技晨检机器人与人工晨检相比,有何优势

普林斯顿大学推出Infinigen AI模型 可生成真实自然环境 3D场景

硅谷人工智能研究院创始人皮埃罗·斯加鲁菲:Transformer模型演讲

如何利用AI工具写好本科论文:科技助你一臂之力

图像生成过程中遭「截胡」:稳定扩散的失败案例受四大因素影响

科学家称,面对人工智能,人类未来或只有灭亡与虚拟永生两个选择

湖北科技职业学院举行工业机器人及智能制造技术专精特新产业学院建设启动仪式

PHP和OpenCV库:如何实现人脸识别

真全息产品,亮相深圳文博会——dipal数伴拓展元宇宙非沉浸式体验

Meta发布语音AI模型 Voicebox 助虚拟助手与NPC对话

AI证件照生成器:实际测试中AI软件展现了绝无仅有的强大效能

调查:过半数艺术家认为 AI 作图无法帮助他们的工作

618京东3C数码趋势产品备受青睐 AR设备成交额同比增长15倍

沐曦首款AI推理GPU亮相:INT8算力达160TOPS!

利亚德加码AI战略,与光年无限图灵机器人全面开展AI研发业务合作

日入400万,第一批AI骗子已上岗

Unity 推出面向开发者的 AI 软件市场 AI Hub,股价飙涨 15%

微软bing聊天推出AI购物工具 可进行比价并查看历史最低价

360°/180°双模式,佳能公布可折叠小体积的VR全景相机

特斯拉门店可能启动机器人卖车?也许不是你想的那样

Snow Kylin登陆中国列车,打造全球首条元宇宙专列

华为发布两款AI存储新品

全国青少年无人机大赛重庆市选拔赛开赛 1252名中小学生参加

看似低调,实则稳健:字节在AI路上会遇到什么?

靠游戏更靠AI 英伟达成唯一首季度两位数增长的公司

科技有狠活|时光修复师 :用AI让昨日重现

如何利用物联网技术提高企业生产线智能化水平,提升生产效率

华为云发布华为云盘古模型3.0和升腾AI云服务,亮点亮相2025华为开发者大会

亲身体验鸿蒙4:AI大模型带来的便利,告别单纯的旁观者状态

Midjourney创始人:AI应该成为人类思想的延伸

IBM 与 NASA 携手开源地理空间 AI 模型,促进气候科学研究进步

650亿参数,8块GPU就能全参数微调:邱锡鹏团队把大模型门槛打下来了

鸿蒙4即将支持大规模AI模型

类GPT模型训练提速26.5%,清华朱军等人用INT4算法加速神经网络训练

【机智云物联网低功耗转接板】远程环境数据采集探索

消息称苹果 iPhone 15 系列健康应用将深度融合 AI 技术

争鸣:OpenAI奥特曼、Hinton、杨立昆的AI观点到底有何不同?

衡水市冀州中学机器人社团在世界机器人大赛中斩获佳绩

人工智能行业急缺人 AI人才年薪能达近42万元

鸿蒙OS 4将实现AI大模型集成,余承东表示坚持AI辅助而非AI取代

《自然》杂志拒绝刊登人工智能生成的图片和视频

微软 Azure AI 文本转语音服务升级:新增男性声音和扩展语言支持

华为推出两款商用 AI 大模型存储新品,支持 1200 万 IOPS 性能

2024-01-26

运城市盐湖区信雨科技有限公司是一家深耕海外推广领域十年的专业服务商,作为谷歌推广与Facebook广告全球合作伙伴,聚焦外贸企业出海痛点,以数字化营销为核心,提供一站式海外营销解决方案。公司凭借十年行业沉淀与平台官方资源加持,打破传统外贸获客壁垒,助力企业高效开拓全球市场,成为中小企业出海的可靠合作伙伴。