AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

本论文第一作者杜超群是清华大学自动化系 2025 级直博生。导师为黄高副教授。此前于清华大学物理系获理学学士学位。研究兴趣为不同数据分布上的模型泛化和鲁棒性研究,如长尾学习,半监督学习,迁移学习等。在 tpami、icml 等国际一流期刊、会议上发表多篇论文。

个人主页:https://andy-du20.github.io

本文介绍清华大学的一篇关于长尾视觉识别的论文: Probabilistic Contrastive Learning for Long-Tailed Visual Recognition. 该工作已被 TPAMI 2025 录用,代码已开源。

该研究主要关注对比学习在长尾视觉识别任务中的应用,提出了一种新的长尾对比学习方法 ProCo,通过对 contrastive loss 的改进实现了无限数量 contrastive pairs 的对比学习,有效解决了监督对比学习 (supervised contrastive learning)[1] 对 batch (memory bank) size 大小的固有依赖问题。除了长尾视觉分类任务,该方法还在长尾半监督学习、长尾目标检测和平衡数据集上进行了实验,取得了显著的性能提升。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

论文链接: https://arxiv.org/pdf/2403.06726

项目链接: https://github.com/LeapLabTHU/ProCo

研究动机

对比学习在自监督学习中的成功表明了其在学习视觉特征表示方面的有效性。影响对比学习性能的核心因素是 contrastive pairs 的数量,这使得模型能够从更多的负样本中学习,体现在两个最具代表性的方法 SimCLR [2] 和 MoCo [3] 中分别为 batch size 和 memory bank 的大小。然而在长尾视觉识别任务中,由于类别不均衡,增加 contrastive pairs 的数量所带来的增益会产生严重的边际递减效应,这是由于大部分的 contrastive pairs 都是由头部类别的样本构成的,难以覆盖到尾部类别。

例如,在长尾 Imagenet 数据集中,若 batch size (memory bank) 大小设为常见的 4096 和 8192,那么每个 batch (memory bank) 中平均分别有 212 个和 89 个类别的样本数量不足一个。

因此,ProCo 方法的核心 idea 是:在长尾数据集上,通过对每类数据的分布进行建模、参数估计并从中采样以构建 contrastive pairs,保证能够覆盖到所有的类别。进一步,当采样数量趋于无穷时,可以从理论上严格推导出 contrastive loss 期望的解析解,从而直接以此作为优化目标,避免了对 contrastive pairs 的低效采样,实现无限数量 contrastive pairs 的对比学习。

然而,实现以上想法主要有以下几个难点:

如何对每类数据的分布进行建模。

如何高效地估计分布的参数,尤其是对于样本数量较少的尾部类别。

如何保证 contrastive loss 的期望的解析解存在且可计算。

事实上,以上问题可以通过一个统一的概率模型来解决,即选择一个简单有效的概率分布对特征分布进行建模,从而可以利用最大似然估计高效地估计分布的参数,并计算期望 contrastive loss 的解析解。

由于对比学习的特征是分布在单位超球面上的,因此一个可行的方案是选择球面上的 von Mises-Fisher (vMF) 分布作为特征的分布(该分布类似于球面上的正态分布)。vMF 分布参数的最大似然估计有近似解析解且仅依赖于特征的一阶矩统计量,因此可以高效地估计分布的参数,并且严格推导出 contrastive loss 的期望,从而实现无限数量 contrastive pairs 的对比学习。

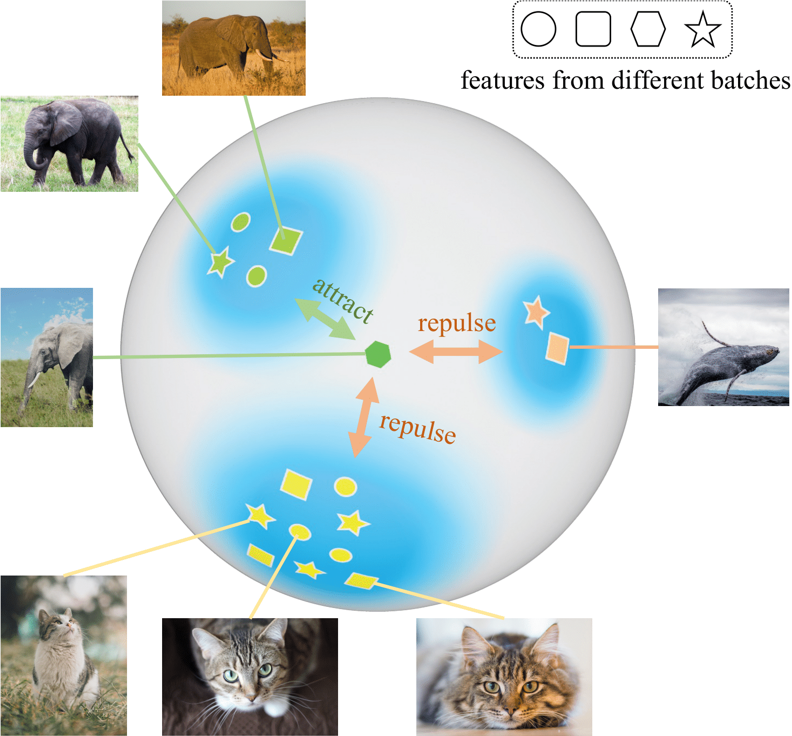

图 1 ProCo 算法根据不同 batch 的特征来估计样本的分布,通过采样无限数量的样本,可以得到期望 contrastive loss 的解析解,有效地消除了监督对比学习对 batch size (memory bank) 大小的固有依赖。

方法详述

接下来将从分布假设、参数估计、优化目标和理论分析四个方面详细介绍 ProCo 方法。

分布假设

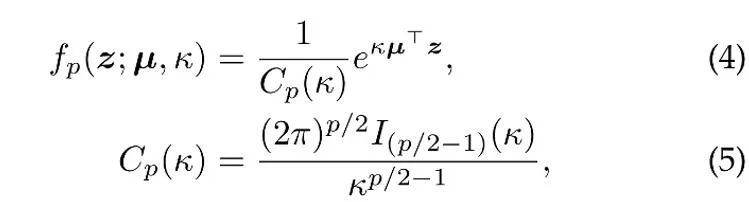

如前所述,对比学习中的特征被约束在单位超球面上。因此,可以假设这些特征服从的分布为 von Mises-Fisher (vMF) 分布,其概率密度函数为:

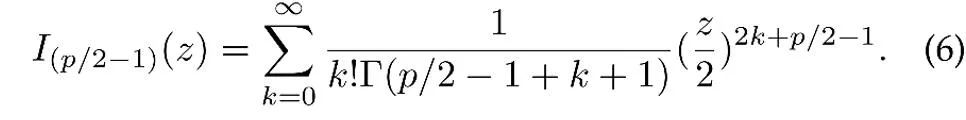

其中 z 是 p 维特征的单位向量,I 是第一类修正贝塞尔函数,

μ 是分布的均值方向,κ 是集中参数,控制分布的集中程度,当 κ 越大时,样本聚集在均值附近的程度越高;当 κ =0 时,vMF 分布退化为球面上的均匀分布。

参数估计

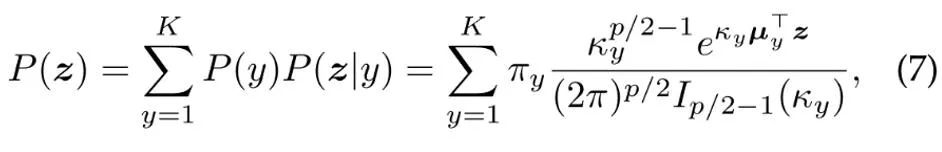

基于上述分布假设,数据特征的总体分布为混合 vMF 分布,其中每个类别对应一个 vMF 分布。

其中参数  表示每个类别的先验概率,对应于训练集中类别 y 的频率。特征分布的均值向量

表示每个类别的先验概率,对应于训练集中类别 y 的频率。特征分布的均值向量 和集中参数

和集中参数 通过最大似然估计来估计。

通过最大似然估计来估计。

假设从类别 y 的 vMF 分布中采样 N 个独立的单位向量,则均值方向和集中参数的最大似然估计 (近似)[4] 满足以下方程:

码上飞

码上飞

码上飞(CodeFlying) 是一款AI自动化开发平台,通过自然语言描述即可自动生成完整应用程序。

430

查看详情

430

查看详情

其中 是样本均值,

是样本均值, 是样本均值的模长。此外,为了利用历史上的样本,ProCo 采用了在线估计的方法,能够有效地对尾部类别的参数进行估计。

是样本均值的模长。此外,为了利用历史上的样本,ProCo 采用了在线估计的方法,能够有效地对尾部类别的参数进行估计。

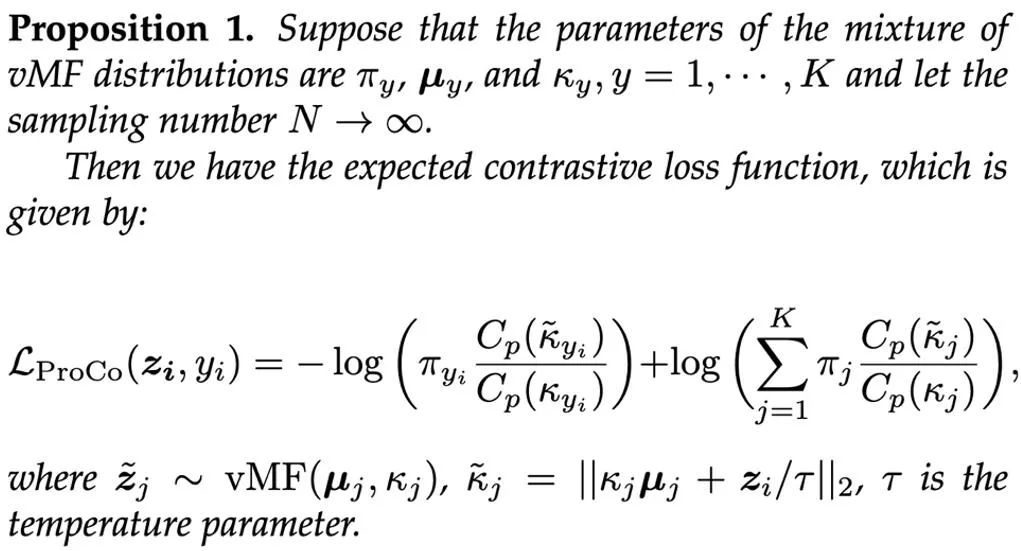

优化目标

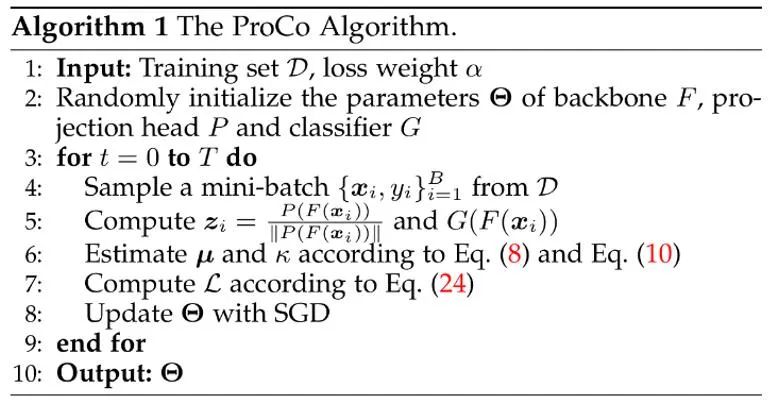

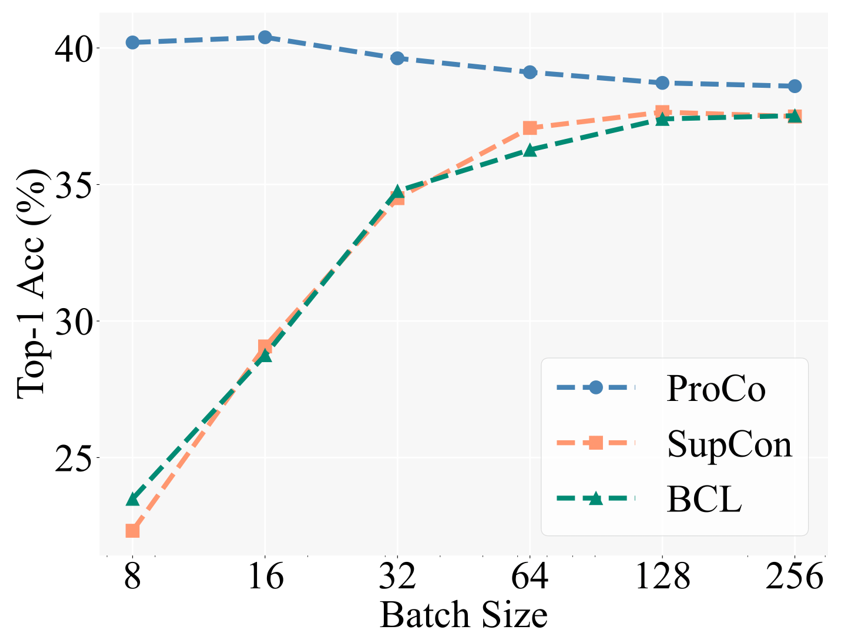

基于估计的参数,一种直接的方法是从混合 vMF 分布中采样以构建 contrastive pairs . 然而在每次训练迭代中从 vMF 分布中采样大量的样本是低效的。因此,该研究在理论上将样本数量扩展到无穷大,并严格推导出期望对比损失函数的解析解直接作为优化目标。

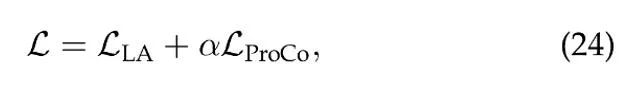

通过在训练过程中引入一个额外的特征分支 (基于该优化目标进行 representation learning),该分支可以与分类分支一起训练,并且由于在推理过程中只需要分类分支,因此不会增加额外的计算成本。两个分支 loss 的加权和作为最终的优化目标,

在实验中均设置 α=1. 最终,ProCo 算法的整体流程如下:

理论分析

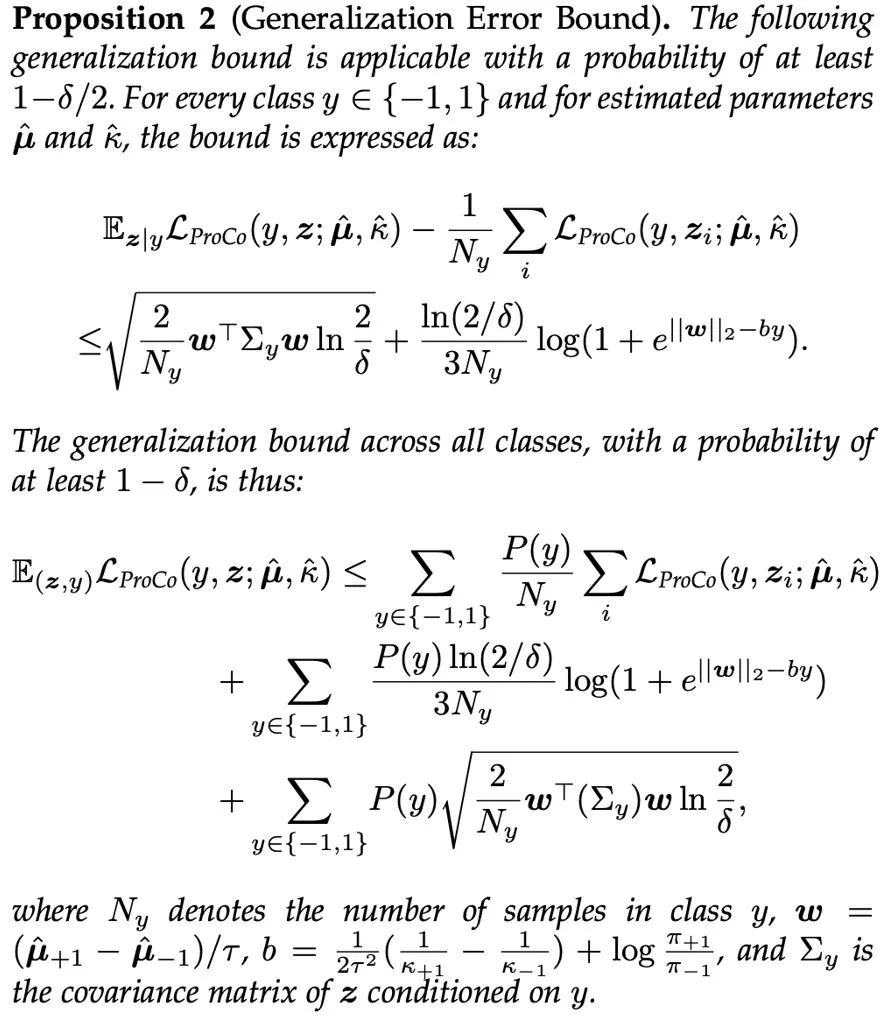

为了进一步从理论上验证 ProCo 方法的有效性,研究者们对其进行了泛化误差界和超额风险界的分析。为了简化分析,这里假设只有两个类别,即 y∈ {-1,+1}.

分析表明,泛化误差界主要由训练样本数量和数据分布的方差控制,这一发现与相关工作的理论分析 [6][7] 一致,保证了 ProCo loss 没有引入额外因素,也没有增大泛化误差界,从理论上保证了该方法的有效性。

此外,该方法依赖于关于特征分布和参数估计的某些假设。为了评估这些参数对模型性能的影响,研究者们还分析了 ProCo loss 的超额风险界,其衡量了使用估计参数的期望风险与贝叶斯最优风险之间的偏差,后者是在真实分布参数下的期望风险。

这表明 ProCo loss 的超额风险主要受参数估计误差的一阶项控制。

实验结果

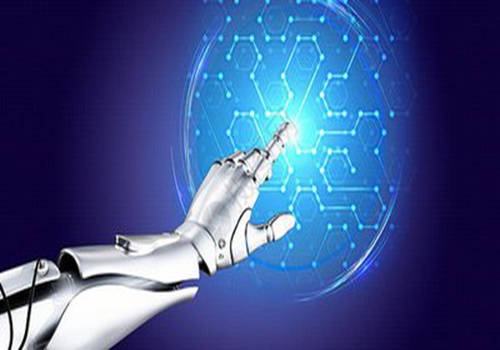

作为核心 motivation 的验证,研究者们首先与不同对比学习方法在不同 batch size 下的性能进行了比较。Baseline 包括同样基于 SCL 在长尾识别任务上的改进方法 Balanced Contrastive Learning [5](BCL)。具体的实验 setting 遵循 Supervised Contrastive Learning (SCL) 的两阶段训练策略,即首先只用 contrastive loss 进行 representation learning 的训练,然后在 freeze backbone 的情况下训练一个 linear classifier 进行测试。

下图展示了在 CIFAR100-LT (IF100) 数据集上的实验结果,BCL 和 SupCon 的性能明显受限于 batch size,但 ProCo 通过引入每个类别的特征分布,有效消除了 SupCon 对 batch size 的依赖,从而在不同的 batch size 下都取得了最佳性能。

size 下都取得了最佳性能。

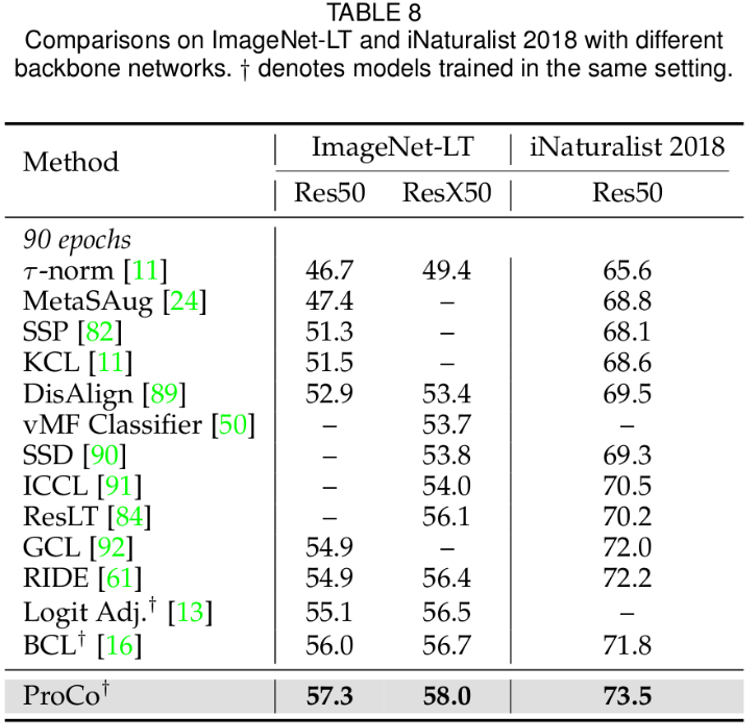

此外,研究者们还在长尾识别任务,长尾半监督学习,长尾目标检测和平衡数据集上进行了实验。这里主要展示了在大规模长尾数据集 Imagenet-LT 和 iNaturalist2018 上的实验结果。首先在 90 epochs 的训练 schedule 下,相比于同类改进对比学习的方法,ProCo 在两个数据集和两个 backbone 上都有至少 1% 的性能提升。

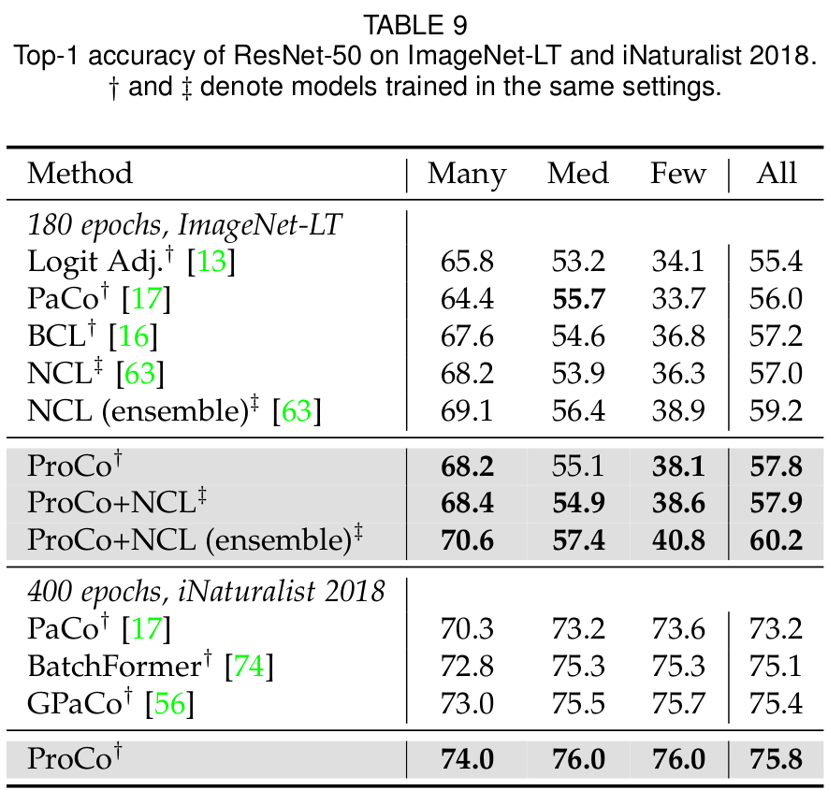

下面的结果进一步表明了 ProCo 也能够从更长的训练 schedule 中受益,在 400 epochs schedule 下,ProCo 在 iNaturalist2018 数据集上取得了 SOTA 的性能,并且还验证了其能够与其它非对比学习方法相结合,包括 distillation (NCL) 等方法。

P. Khosla, et al. “Supervised contrastive learning,” in NeurIPS, 2025.

Chen, Ting, et al. "A simple framework for contrastive learning of visual representations." International conference on machine learning. PMLR, 2025.

He, Kaiming, et al. "Momentum contrast for unsupervised visual representation learning." Proceedings of the IEEE/CVF conference on computer vision and pattern recognition. 2025.

S. Sra, “A short note on parameter approximation for von mises-fisher distributions: and a fast implementation of is (x),” Computational Statistics, 2012.

J. Zhu, et al. “Balanced contrastive learning for long-tailed visual recognition,” in CVPR, 2025.

W. Jitkrittum, et al. “ELM: Embedding and logit margins for long-tail learning,” arXiv preprint, 2025.

A. K. Menon, et al. “Long-tail learning via logit adjustment,” in ICLR, 2025.

以上就是TPAMI 2025 | ProCo: 无限contrastive pairs的长尾对比学习的详细内容,更多请关注其它相关文章!

# 中平

# 黑帽seo小旋风

# 黄埔手机网站建设

# seo的内链工作

# 遂宁seo招聘

# 巢湖建设网站流程

# 诸城抖音网站建设

# seo企业发展

# 亚马逊优惠券推广网站

# 营销推广 怎么做好

# 重点网站品牌推广

# 一言

# 工程

# 广州

# 有效地

# 量产

# 还在

# 清华大学

# 理论上

# 进行了

# 均值

# type

# git

# 长尾视觉识别

相关栏目:

【

Google疑问12 】

【

Facebook疑问10 】

【

优化推广96088 】

【

技术知识133117 】

【

IDC资讯59369 】

【

网络运营7196 】

【

IT资讯61894 】

相关推荐:

OpenAI大神Karpathy最新分享:为什么OpenAI内部对AI Agents最感兴趣

智能手机应用中的人工智能的重要性

速途网络成立“人工智能专家委员会”5位中美博士加盟

了解 AGI:智能的未来?

OpenAI 为开发者推出 GPT 聊天机器人 API 大更新,同时降低价格

微盟宣布联合腾讯云共建行业大模型:加快激活AI大模型智能应用

AI 大模型重塑软件开发,有哪些落地前景和痛点?| ArchSummit

华为大模型登Nature正刊!审稿人:让人们重新审视预报模型的未来

专家解读国家网信办深度合成服务算法备案信息公告:不等于百度、阿里、腾讯等生成式AI产品获批

OpenAI限制网络爬虫访问以保护数据免被用于AI模型训练

尼康尼克尔 Z 180-600mm f/5.6-6.3 VR 镜头发布,12499 元

电池比 Air 2S 大 20%,大疆 Air 3 无人机现身 FCC

AI大模型火了!科技巨头纷纷加入,多地政策加码加速落地

可按用户语气自动回复消息,Zoom 推出基于生成式 AI 的新功能

江永:精准施训提升通信无人机应急救援能力

特斯拉门店可能启动机器人卖车?也许不是你想的那样

抢占新赛道 加快机器人产业集聚发展

对艺术家拒绝置若罔闻,Stability AI 将推出适应多种画风的开源模型

2025 WAIC|美团无人机发布第四代新机型

AI大举入侵内容行业,哪些上市*及动漫公司进行了布局?

13 个提高生产力的 AI 工具

OpenOOD更新v1.5:全面、精确的分布外检测代码库及测试平台,支持在线排行榜、一键测试

谷歌计划在上海举办开发者大会,重点关注机器学习和生成式AI领域

马斯克嘲讽人工智能:机器学习本质就是统计学

360发布认知型通用大模型“360智脑4.0” 全面接入360全家桶

无需标注数据,「3D理解」进入多模态预训练时代!ULIP系列全面开源,刷新SOTA

国网辉南供电:无人机空中巡检 全力护航端午佳节

马斯克回应“人工智能让一切变得更好”:我们已经是半机器人了

英伟达推出 L40S GPU,AI 推理性能超过 A100 约 1.2 倍

微软更新服务协议,以防止通过AI服务进行逆向工程和数据抓取

RoboNeo操作教程

用人工智能技术,亚马逊为用户生成产品评论摘要,帮助他们轻松选购

大语言模型的视觉天赋:GPT也能通过上下文学习解决视觉任务

70年前他本想逃避考试,却影响了整个互联网

剧透!蜜小豆@2025世界人工智能大会多个亮点曝光

昌吉市利用无人机实现全天候河道动态巡检

时间、空间可控的视频生成走进现实,阿里大模型新作VideoComposer火了

首部国内AI辅助动画片《魔游纪:人工智能辅助篇》预告发布

微软必应聊天现已在Chrome和Safari浏览器上可用,但仍有许多限制存在

谷歌内部正在测试代号为Genesis的AI新闻写作产品

烟台大学学生首次在全国大学生无人机航拍竞赛中获奖

腾讯机器狗进化:通过深度学习掌握自主决策能力

AI+音乐如何“生成”动听旋律?一起揭秘世界人工智能大会开场曲

苹果AR头显商标与华为撞车,在中国或改名

昆仑万维与全球领先的元宇宙公司Meta达成商务合作,共同认可昆仑万维在XR领域的技术实力

微软推出 LLaVA-Med AI 模型,可对医学病理案例进行分析

下一个前沿:量子机器学习和人工智能的未来

联想举办2025创新开放日,展出260余项算力及AI产品技术

两型无人机完成交付!国家级机动观测业务正式启动

大疆 DJI Mini 4 Pro 无人机曝光:流线设计,有望迎来功能性提升

2024-07-25

运城市盐湖区信雨科技有限公司是一家深耕海外推广领域十年的专业服务商,作为谷歌推广与Facebook广告全球合作伙伴,聚焦外贸企业出海痛点,以数字化营销为核心,提供一站式海外营销解决方案。公司凭借十年行业沉淀与平台官方资源加持,打破传统外贸获客壁垒,助力企业高效开拓全球市场,成为中小企业出海的可靠合作伙伴。